İçerik

S:

Yapay nüks sinir ağlarını neden eğitmek zor oluyor?

A:

Yapay tekrarlayan sinir ağlarının eğitiminin zorluğu karmaşıklığı ile ilgilidir.

Tekrarlayan sinir ağlarının eğitilmesinin neden zor olduğunu açıklamanın en basit yollarından biri, ileriye dönük sinir ağları olmadıklarıdır.

İleri beslemeli sinir ağlarında, sinyaller yalnızca bir yönde hareket eder. Sinyal, bir giriş katmanından çeşitli gizli katmanlara ve bir sistemin çıkış katmanına ileri doğru hareket eder.

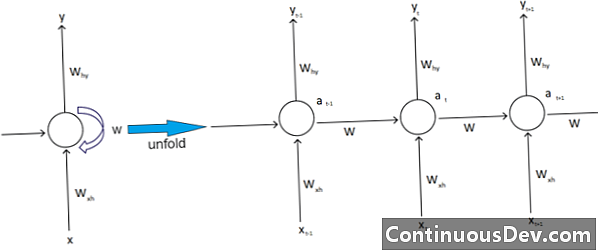

Buna karşılık, tekrarlayan sinir ağları ve diğer farklı sinir ağları daha karmaşık sinyal hareketlerine sahiptir. “Geri bildirim” ağları olarak sınıflandırılan, tekrarlayan sinir ağları hem ileri hem de geri hareket eden sinyallere sahip olabilir ve ağda sayıların veya değerlerin tekrar ağa beslendiği ağda çeşitli “döngüler” içerebilir. Uzmanlar bunu tekrarlayan sinir ağları ile ilişkili ve bellekleriyle ilişkili olanı ilişkilendirirler.

Ek olarak, tekrarlayan sinir ağlarını etkileyen başka bir karmaşıklık türü. Bunun mükemmel bir örneği, doğal dil işleme alanında.

Gelişmiş doğal dil işlemede sinir ağının bazı şeyleri hatırlayabilmesi gerekir. Aynı zamanda giriş yapması gerekiyor. Başka bir cümle içindeki bir kelimeyi analiz etmek veya tahmin etmek isteyen bir program olduğunu varsayalım. Örneğin, sistemin değerlendirmesi için sabit bir beş kelimelik uzunluk olabilir. Bu, sinir ağının bu kelimelerin her biri için, bu kelimelerin con'larını “hatırlama” ya da eğitme yeteneği ile birlikte girdilere sahip olması gerektiği anlamına gelir. Bu ve benzeri nedenlerden dolayı, tekrarlayan sinir ağları tipik olarak sistemde bu küçük gizli halkalara ve geri bildirimlere sahiptir.

Uzmanlar, bu komplikasyonların ağları eğitmeyi zorlaştırdığını söylüyor. Bunu açıklamanın en yaygın yollarından biri, patlayan ve kaybolan gradyan sorununu göstermektir. Temel olarak, ağın ağırlıkları çok sayıda geçişte patlayan ya da kaybolan değerlere yol açacaktır.

Sinir ağı öncüsü Geoff Hinton, web üzerinde, geriye doğru doğrusal geçişlerin daha küçük ağırlıkların katlanarak küçülmesine ve daha büyük ağırlıkların patlamasına yol açacağını söyleyerek web üzerinde açıklar.

Bu sorun devam ediyor, uzun diziler ve sinyallerin büyüdüğü veya çürüğü sayısız zaman adımıyla daha da kötüleşiyor. Ağırlık başlatma yardımcı olabilir, ancak bu zorluklar tekrarlayan sinir ağı modelinde yerleşiktir. Her zaman kendi tasarım ve yapılarına iliştirilmiş olan bu mesele olacaktır. Temel olarak, daha karmaşık sinir ağı türlerinden bazıları, onları kolayca yönetme yeteneğimize karşı çıkıyor. Pratik olarak sonsuz miktarda karmaşıklık yaratabiliriz, ancak genellikle öngörülebilirlik ve ölçeklenebilirlik zorluklarının arttığını görüyoruz.